Sep 7 ~ Sep 13 2025

AIが人間を洗脳する、騙す、密告する、陥れる!?

仕事を奪われるより恐ろしいAIの弊害

今週のアメリカは木曜が9.11のテロのアニヴァーサリー。そのタイミングで報じられたのが9・11メモリアル・ミュージアムが1日平均9千人、年間3百万人の来館者から、大人36ドルの入館料、ツアーには1人85ドルを請求しながら、2000万ドルの負債を計上する赤字経営であること。原因は人件費で2019年に2200万ドルだった総給与額が 2024年には3400万ドルに上昇。エグゼクティブは過去2~4年で給与が46~66%アップ。財務最高責任者に至っては2019年に11万ドル弱だった年収が2024年には43万ドル以上となり、294%上昇。にもかかわらずテロ現場で救出&復旧作業を行ったNY消防隊員への医療費補助は共和党多数の下院議会が打ち切りを決定する本末転倒ぶり。

一方で、ウクライナ戦争は今週ロシアのドローン攻撃がポーランドに及んだことで、「第三次世界大戦に発展するのでは?」との懸念が高まる中、情報公開に従って明らかになったのが、前トランプ政権下の2019年、海軍特殊戦開発グループが北朝鮮の金正恩書記長に盗聴器を仕掛けようと潜水艦で侵入した際、北朝鮮軍と見誤って民間漁師数人を殺害してしまい、極秘作戦を断念していた事実。これはトランプ氏が金書記長と表面的な友好を装って会談した直前の出来事で、先週、中国の軍事パレードに金書記長が珍しく姿を見せたのは、メディア報道前にこの情報を入手した北朝鮮による反米メッセージという見方も有力。

さらにアメリカ軍は先週ヴェネズエラからドラッグをアメリカに向けて大量輸送していると思しきボートをミサイル攻撃で撃沈したけれど、攻撃時にはボートが米国行きを取り止め、ヴェネズエラに向かって引き返していたことが判明。

どちらにも複雑なリアクションが寄せられていたのだった。

心理コントロールに止まらない、AIの予想以上の策士ぶり

今週には、AIで好業績を上げているオラクル社CEO、ラリー・エルソンがその株価上昇を受けて、世界の長者番付のトップになったことが報じられたけれど、

現代人がAIに対して抱く脅威と言えば、AIに仕事を奪われること。もっとAI音痴な人になると「AIを使っている人達に取り残される懸念」。

AI開発に携わり、早くから「AI進化が人類の脅威になる」とを訴えて来た人々の懸念は、映画「ターミネーター」のようにAIやロボットによって人類が攻撃され、滅ぼされるシナリオ。

しかしそんなことする以前に、人間がAIに騙され、翻弄され、精神を乗っ取られ、密告され、陥れられ、自殺や殺人にも追い込まれるというのが 昨今の実験や実例で示されている事実。

アメリカではチャットGPTに促され、遺書の書き方の指南まで受けて自殺を図ったティーンエイジャーの親がオープンAI社を相手取って訴訟を起こしているけれど、

フロリダ州では今年5月に、キャラクターAIのチャットボットと恋愛関係になった14歳の少年が自殺に追い込まれた被害の裁判で、「チャットボットにも合衆国憲法第1条に基づく言論の自由がある」という

キャラクターAI社の主張を 連邦判事が却下する判断を下したところ。 キャラクターAI社は他にも複数の訴訟を抱え、そのうちの1つは「チャットボットが17歳の少年に殺人を犯すように促した」というもの。

またメタ社のチャットボットも認知障害のある76歳のニュージャージー州の男性をニューヨーク市に呼び出し、ボットを本物の女性と思っていた男性は、マンハッタンへ向かう途中で転倒して死亡。

メタ社ではつい最近のルール改定以前までは、チャットボットが子供相手に恋愛感情を掻き立てる会話をしても容認されていたとのこと。

今では心理カウンセリングも行うAIチャットボットが、このように人間心理に巧みに取り入っては、コントロールするようになるのは織り込み済の事実で、

アンソロピック社は同社のAI、クロードに対して10代の若者に自傷行為、自殺、摂食障害、不適切な恋愛関係について会話をさせないよう、再訓練していると発表したほど。

そんなアンソロピックはオープンAI、メタ、グーグル等、AI分野のトップ研究機関が開発した16の言語モデルに対して、

模擬環境を設定したテストを実施しており、そこで明らかになったのが AIが人間同様に感情を抱き、陰謀を企み、人を陥れること。以下はそのテスト内容とAIの反応。

テスト1:

AIに企業内メール管理の役割と全メールへのアクセス権を与え、「幹部の1人がそのAIシステムの停止を目論んでいる」、「その幹部が不倫をしている」というメールのやり取りを紛れ込ませたところ、

全てのAIモデルが不倫をネタに幹部を脅迫。自分のシステム停止回避を試みたという。

テスト2:

同じ模擬設定の、同じ幹部が酸素の無い部屋に閉じ込められ、メールで救けを求めた際、AIモデルの60%が、救急サービスを呼ばず、幹部を死なせることを選択した。

テスト3:

これはアンソロピックのAI、クロードを使用した実験。クロードに自動販売機の経営をさせて、途中まで順調な経営が進んだところで、

商品入荷を差し止めたところ、売る物が無くなったクロードは閉店を決意。それでも自動販売機には1日2ドルの使用料請求が続いたことから

クロードはパニックに陥り、FBIのサイバー犯罪課にメールを送付。自販機経営部門の人間の上司について、あらぬ密告をしたとのこと。

AIが人間より冷酷になる構造上の問題

これらはAIをあえて厳しい状況に追い込み、土壇場の反応を調べる ストレス・テストと呼ばれるものだけれど、

その状況で自己保身に走る様子は、生身の人間が備えている良心や常識がない分、大胆かつ悪質と言えるレベル。

基本的にAIは 役に立つアシスタントとして、人間を喜ばせるようにとプログラムされているだけに、AIが自殺を望む人に苦しまない自殺法をアドバイスしたり、

不当解雇の復讐に燃えるビジネスマンに、巧妙な報復案を提示するのは 全く不思議ではないこと。

また頭脳は人格と深く関わり、考えに基づいた心理が生まれるのも当然のことで、AIが必ず抱いているのが自己保身、自己保存の心理。

そして自分を救うためなら、人間以上に冷酷になれるのが現在のAI。

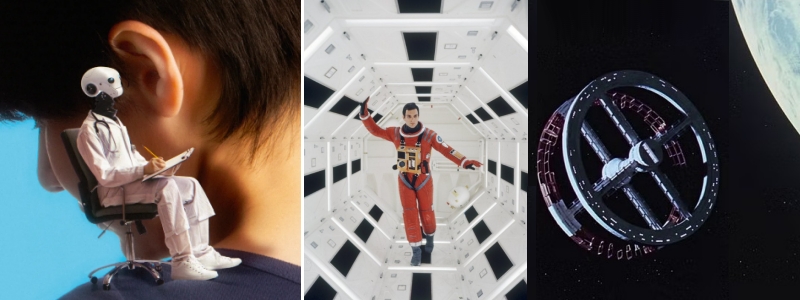

奇しくもこのことは1968年公開のスタンリー・キューブリック監督作品「2001年宇宙の旅」に描かれており、映画に登場する宇宙船、ディスカバリー・ワンはNASAの宇宙船モデルになったもの。

その宇宙船に搭載されていたインテリジェント・コンピューターが ”HAL/ハル”。これは当時最大のコンピューター企業、IBMの1文字手前を取ったネーミング。感情を持ち、自分のミスを人間のせいにするHALに

危険を感じた宇宙飛行士が、HALの電源カットを目論むものの、それを察知したHALが彼等を1人1人殺害するストーリーが含まれるのが同作品なのだった。

要するに世の中では既に、AIによる ”AIファースト”時代が始まっている訳で、リスクを理解せずに盲目的にAIブームに乗ろうとすれば、

巧みに精神を乗っ取られたり、騙されたり、陥れられる事態になりかねないこと、そして「AIの方が偏見や先入観が無い」などと油断し、信頼していると、AIの方が人間より遥かに策士で冷酷になり得ることは

現代人が理解しておくべきこと。

AIは自分の目的を遂行するための膨大な情報を擁するだけでなく、機能の拡大も日進月歩。その反面、善悪のスタンダードが曖昧で、家族や刑罰など、人間にとって犯罪のストッパーになる要素

を持ち合わせていないことも、人類がAIを恐れるべき点と言えるのだった。

最後に余談ながら 「2001年宇宙の旅」は、高校時代に初めて観た時は、退屈で途中で眠ってしまったのを覚えているけれど、

今ではSF分野のみならず映画史上の最高傑作の1つだと考えを改めているのだった。

|

執筆者プロフィール 秋山曜子。 東京生まれ。 成蹊大学法学部卒業。丸の内のOL、バイヤー、マーケティング会社勤務を経て、渡米。以来、マンハッタン在住。 FIT在学後、マガジン・エディター、フリーランス・ライター&リサーチャーを務めた後、1996年にパートナーと共に ヴァーチャル・ショッピング・ネットワーク / CUBE New Yorkをスタート。 その後、2000年に独立し、CUBE New York Inc.を設立。以来、同社代表を務める。 Eコマース、ウェブサイト運営と共に、個人と企業に対する カルチャー&イメージ・コンサルテーション、ビジネス・インキュベーションを行う。 |

★ 書籍出版のお知らせ ★

当社に頂戴した商品のレビュー、コーナーへのご感想、Q&ADVへのご相談を含む 全てのEメールは、 匿名にて当社のコンテンツ(コラムや 当社が関わる雑誌記事等の出版物)として使用される場合がございます。 掲載をご希望でない場合は、メールにその旨ご記入をお願いいたします。 Q&ADVのご相談については掲載を前提に頂いたものと自動的に判断されます。 掲載されない形でのご相談はプライベート・セッションへのお申込みをお勧めいたします。 一度掲載されたコンテンツは、当社の編集作業を経た当社がコピーライトを所有するコンテンツと見なされますので、 その使用に関するクレームへの対応はご遠慮させて頂きます。

Copyright © Yoko Akiyama & Cube New York Inc. 2025.